xGen-MM是什么

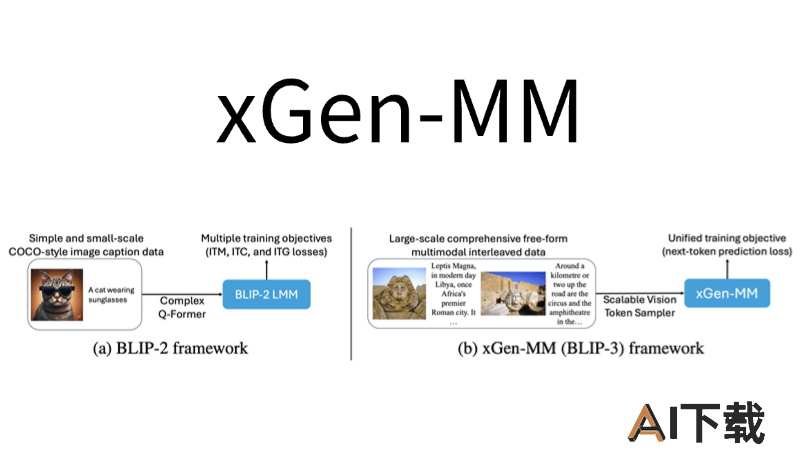

xGen-MM是Salesforce推出的一款开源多模态AI模型,具有处理交错数据的能力,能同时理解和生成文本、图像等多种数据类型。xGen-MM通过学习大量的图片和文字信息,不仅在视觉语言任务上展现出强大的性能,还通过开源模型、数据集和微调代码库,促进模型能力的不断提升。

xGen-MM的主要功能

多模态理解:xGen-MM能同时处理和理解图像和文本信息,支持回答关于视觉内容的问题。大规模数据学习:通过大量多样化的数据训练,xGen-MM能捕捉到丰富的视觉和语言模式。高性能生成:xGen-MM不仅能理解输入信息,还能生成文本,比如根据一张图片编写描述或回答。开源可访问:xGen-MM的模型、数据集和代码是开源的,研究人员和开发者可以自由地访问和使用这些资源来构建自己的应用。微调能力:用户可以根据自己的特定需求对xGen-MM进行微调,适应不同的应用场景。xGen-MM的项目地址

GitHub仓库:https://github.com/salesforce/LAVIS/tree/xgen-mmHugging Face模型库:https://huggingface.co/Salesforce/xgen-mm-phi3-mini-instruct-interleave-r-v1.5arXiv技术论文:https://arxiv.org/pdf/2408.08872xGen-MM的技术原理

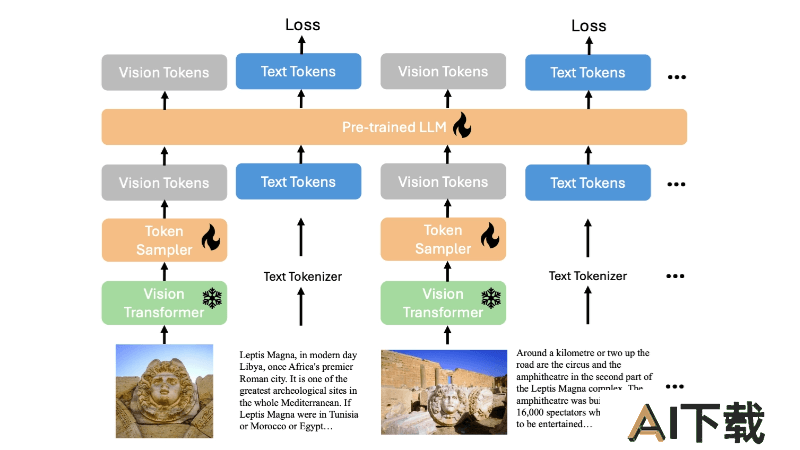

多模态学习:xGen-MM通过训练能够同时理解图像和文本数据,实现视觉和语言信息的融合。大规模数据集:模型在大规模、多样化的数据集上进行训练,数据集包含丰富的图像和相应的描述。视觉令牌采样器:xGen-MM使用高效的视觉令牌采样器(如Perceiver架构)来处理图像数据,支持模型以可扩展的方式处理不同分辨率的图像。预训练语言模型:结合了预训练的大型语言模型(如Phi-3模型),模型已经在大量文本数据上训练,具有强大的语言理解能力。统一的训练目标:简化训练过程,通过单一的自回归损失函数来训练模型,专注在多模态上下文中预测文本令牌。指令微调:模型可以通过指令微调来更好地理解和执行用户的查询,在特定任务上对预训练模型进行额外的训练。后训练优化:包括直接偏好优化(DPO)和安全性微调,提高模型的有用性、减少幻觉效应和提高安全性。开源和可定制性:xGen-MM的代码、模型和数据集都是开源的,允许社区成员根据自己的需求进行定制和进一步开发。